De två marknadsledande minnestillverkarna Samsung och SK Hynix kommer under 2025 båda satsa på AI-produkter – men med olika fokus, enligt Digitimes. Samsung väntas lägga merparten av sitt krut på att nå ut med LPDDR6 under året, vilket är tänkt att ge edge-enheter den ökade minnesbandbredd som krävs för att köra AI-applikationer effektivt lokalt.

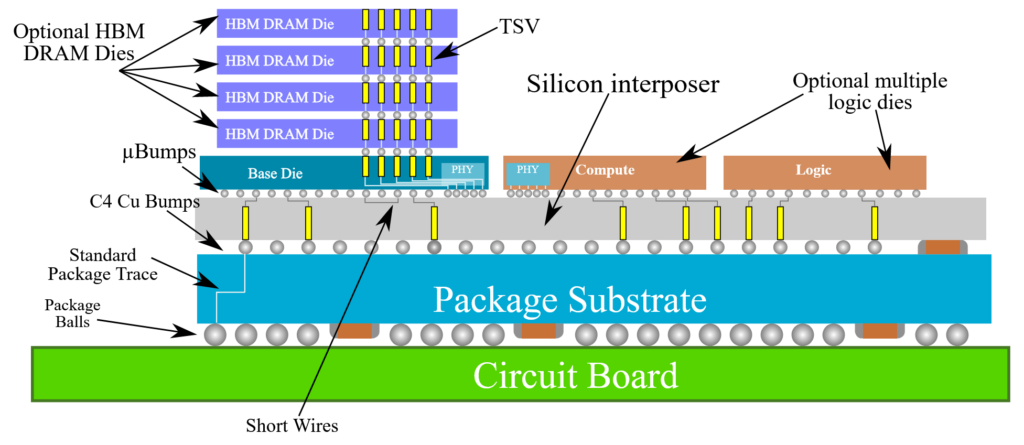

SK Hynix å sin sida är tack vare sitt fokus på minne av HBM-typ marknadsledande i världens datacenter, inte minst tack vare att bolaget är kvalificerad leverantör till Nvidia. Då AI-boomen inte visar några tecken på att avta i närtid väntas SK Hynix satsa på att befästa denna avundsvärda position genom att under 2025 införa mer avancerade paketeringslösningar för sitt HBM.

Intressant nog ingick SK Hynix under 2024 en allians med den marknadsledande kontraktstillverkaren TSMC gällande nästa generations HBM – HBM4. Tanken här är att SK Hynix ska leverera minneskretsar som TSMC sedan paketerar mer integrerat än vad som hittills kunnat åstadkommas. Att TSMC lyckats skala upp sin kapacitet för avancerad paketering snabbare än väntat innebär däremot inte att SK Hynix är tillfreds, utan under 2025 kommer bolaget introducera sina egna avancerade paketeringslösningar.

Exakt hur det hela är tänkt att ske är ännu inte klart, då SK Hynix hittills helt saknar paketeringskunskap. Enligt Digitimes, med hänvisning till ET News, kan strategiska partnerskap med OSAT-aktörer (Outsourced Assembly and Test) likt Amkor bli aktuella. Det enda som ter sig sannolikt är att det rör sig om ännu en 2.5D-paketeringsteknik enligt receptet fan-out wafer-level packaging (FOWLP), ett alternativ till TSMC:s CoWoS.

Anledningen till att SK Hynix ger sig på att konkurrera med sin allianspartner TSMC är densamma som tvingat Nvidia till att hitta alternativa lösningar när CoWoS-kapaciteten hos TSMC slagit i taket – bolaget har fler ordrar än de kan leverera. Genom att införa egna paketeringslösningar, om än inte lika avancerade som de som TSMC kan leverera, är minnesleverantören inte lika beroende av en extern parts kapacitet – även om den externa parten råkar ha över 60 procent av världsmarknaden.

Samsung å sin sida har gått på HBM-pumpen åtskilliga gånger. Bolagets produkter är fortsatt inte kvalificerade för integration i Nvidias datacenterkort, något som tvingat bolaget att svälja stoltheten och ingå partnerskap med TSMC för HBM4-projekt. Vägen till Samsungs relevans inom AI är istället primärminnestypen LPDDR6, där bolaget som bäst arbetar på att ratificera minnestypen hos standardiseringsorganet JEDEC tillsammans med rivalen SK Hynix.

LPDDR6-kretsar uppges testas hos Samsung, varefter bolaget ska ägna större delen av 2025 till att finjustera dess kretsar. Mot slutet av året är tanken att kretsarna ska nå externa parter i form av förproduktionsexemplar. Nytt för LPDDR6 är en 12DQ-arkitektur, där sex grupper av celler sammanfogas i en tvåkanalig struktur, upp från 8DQ med fyra grupper i LPDDR5. I teorin erbjuder detta, om allt annat lämnas orört, en 50-procentig ökning i bandbredd – vilket ska ge körning av lokala AI-arbetslaster en chans på edge-enheter.

Marknaden för AI som körs on-device väntas växa med 37,7 procent årligen (CAGR) till 173,9 miljarder USD år 2030. Tekniken är också närmare besläktad med det traditionella minne av DDR-typ som Samsung byggt sin marknadsdominans på – men med en så stor potentiell total marknad lär heller SK Hynix inte låta minnestypen gå obemärkt förbi.